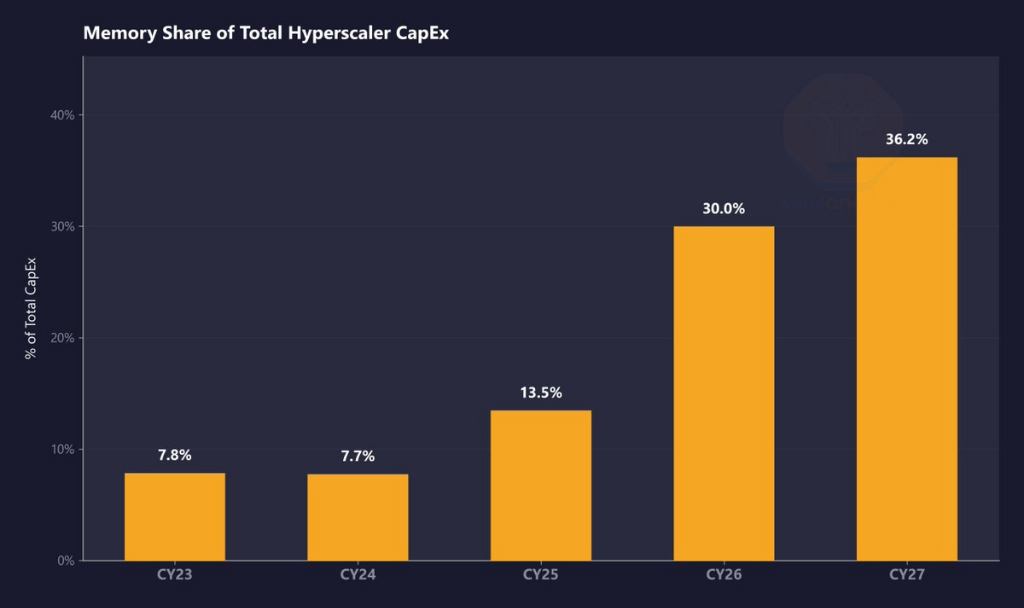

¡Después del "impuesto Nvidia" viene el "impuesto de memoria"! El costo de la infraestructura de IA está fuera de control: la proporción de memoria en los gastos de capital aumentará hasta un 30%

La carrera armamentista de la IA está dando lugar a una profunda crisis inflacionaria. Después de que la alta prima de las GPU de Nvidia fuera denominada “impuesto Nvidia”, ahora un nuevo “impuesto de memoria” está tomando forma silenciosamente.

Según estimaciones de la firma de investigación de mercado SemiAnalysis, entre 2023 y 2024, el gasto en memoria representa aproximadamente el 8% del gasto total de capital de los proveedores de computación en la nube a hiperescala; se estima que este porcentaje saltará al 30% en 2026 y aumentará aún más en 2027, un cambio de casi cuatro veces en cuatro años.

Esta inflación de memoria ya está impactando de manera significativa los resultados financieros de los proveedores de servicios cloud a hiperescala. Microsoft prevé que los precios más altos de los componentes de hardware aumentarán su gasto de capital anual en 25.000 millones de dólares, llevando el total a unos asombrosos 190.000 millones de dólares. Meta, por su parte, elevó el valor medio previsto de su gasto de capital en 10.000 millones de dólares, atribuyendo principalmente este aumento al coste de los componentes, en especial los chips de memoria. Los últimos informes financieros de ambas compañías reflejan la trampa inflacionaria de “chips” en la que están atrapados la mayoría de los proveedores de computación en la nube a gran escala. El jefe global de investigación de acciones de Goldman Sachs, James Covello, fue directo:

Casi todo el valor se acumula en la capa de chips, algo sin precedentes y, a largo plazo, no sostenible. La bonanza de las empresas de chips se produce a costa de todas las demás empresas en la cadena de suministro.

Del “impuesto Nvidia” al “impuesto de memoria”: la presión de costes se transfiere hacia arriba

Las GPU de Nvidia han sido consideradas durante mucho tiempo el “mayor recaudador de impuestos” del gasto de capital en IA por la industria. Sus chips aceleradores de IA alcanzan un margen bruto del 75% y, gracias a su posición monopolística en el mercado de aceleradores de IA, imponen continuamente una prima oculta a los proveedores cloud a hiperescala, fenómeno conocido como “impuesto Nvidia”.

Sin embargo, está surgiendo una nueva presión de costes. El columnista de Bloomberg Chris Bryant señala que, las empresas tecnológicas se ven cada vez más obligadas a pagar un “impuesto de memoria”, debido al consumo descomunal de memoria por parte de los centros de datos. La razón central es que los aceleradores de IA convencionales requieren grandes cantidades de memoria de alto ancho de banda (HBM), un tipo de DRAM (memoria dinámica de acceso aleatorio) altamente lucrativa y que consume mucho silicio, la cual provee almacenamiento temporal rápido para datos y aplicaciones.

Según el análisis de SemiAnalysis, los factores clave que impulsan esta tendencia incluyen: se espera que los precios de la DRAM se dupliquen en 2026, y vuelvan a registrar porcentajes de aumento de dos cifras en 2027; el precio contractual de LPDDR5 ya se ha triplicado desde el primer trimestre de 2025, y el precio de mercado abierto podría superar los 10 dólares por GB en el primer trimestre de 2026; la oferta estructural de HBM sigue estando por debajo de la demanda.

SemiAnalysis también señala un hecho frecuentemente ignorado por el mercado: Nvidia goza de un precio de adquisición de DRAM “altamente preferente” (VVP), significativamente más bajo que el precio que obtienen los proveedores de nube a hiperescala y el mercado en general. Este acuerdo reduce el riesgo de costes para Nvidia en sus propios servidores y a la vez baja la referencia de precios de mercado global, enmascarando la verdadera gravedad de la escasez de suministro.

Tres gigantes cosechando beneficios: las ganancias de la industria de la memoria alcanzan récords históricos

El poder en el mercado de la memoria está sumamente concentrado en tres empresas: SK Hynix y Samsung Electronics de Corea, y Micron Technology de Estados Unidos. El valor combinado de mercado de estas tres supera los 2.8 billones de dólares.

Los datos financieros de estos proveedores son asombrosos. El margen operativo de SK Hynix en el último trimestre llegó al 72%, cifra récord; la empresa admitió que sus clientes “dan prioridad a asegurar volumen de compra sobre la negociación de precios”. El precio de venta promedio de DRAM de Samsung en el mismo periodo subió más del 90% trimestre a trimestre.

Desde la perspectiva del mercado, el precio de las acciones de los proveedores de hardware de IA supera ampliamente el de los compradores de servicios cloud a hiperescala. TSMC planea invertir este año unos 56.000 millones de dólares, un récord, pero aún insuficiente para satisfacer la demanda de productos de vanguardia. Elon Musk incluso está considerando construir su propia fábrica de chips, con un gasto estimado entre 55.000 y 119.000 millones de dólares.

SemiAnalysis advierte que el impacto de la inflación de la memoria ya se refleja en parte en las previsiones de gasto de capital para 2026, pero la reevaluación de precios de 2027 aún no está incluida en las proyecciones actuales de Wall Street.

Tecnológicas en busca de soluciones: ¿podrán los chips propios romper la prima monopólica?

Ante los elevados costes de adquisición, los proveedores cloud a hiperescala exploran activamente el desarrollo de chips propios, con la esperanza de reducir su dependencia de Nvidia y de los proveedores de memoria.

Se estima que el chip Trainium de desarrollo propio de Amazon podría ahorrarle a la empresa miles de millones de dólares anualmente. Es relevante destacar que Anthropic y OpenAI han firmado contratos de adquisición de chips por varios miles de millones con Amazon, aunque la mayor parte de la capacidad ya ha sido vendida o reservada a corto plazo. El procesador Tensor de Google (TPU), Trainium de Amazon y Maia 200 de Microsoft representan la estrategia de los grandes proveedores cloud para reducir dependencias externas.

Para reducir el coste de la memoria, la tecnología de compresión TurboQuant de Google podría ser clave, y Arm Holdings afirma que su nueva generación de CPUs puede rebajar en unos 10.000 millones de dólares el coste de construcción de un centro de datos por gigavatio.

No obstante, las alternativas todavía enfrentan limitaciones de capacidad. La construcción de fábricas de semiconductores lleva años, lo que dificulta una respuesta efectiva de oferta en el corto plazo; además, la industria tiene un fuerte carácter cíclico, y muchas empresas siguen siendo cautas respecto a expansiones agresivas de capacidad.

Efectos de desborde: un coste doble para el mercado de consumo y la economía global

El auge del hardware de IA está extendiendo sus costes por toda la economía en múltiples formas.

En el sector de bienes de consumo, los fabricantes de chips de memoria están priorizando la capacidad de producción para pedidos a largo plazo y más rentables del mercado cloud de hiperescala, dejando a los fabricantes de smartphones, consolas de juegos y PC en una situación de escasez de suministros; estos deben elegir entre subir precios, reducir especificaciones o aceptar menores márgenes de beneficio. Se prevé que las ventas globales de teléfonos inteligentes caigan un 13% este año, y el segmento de gama baja será el más impactado. Nintendo ya ha anunciado que subirá el precio de la Switch 2.

A nivel macro, la importación de hardware relacionado con IA en algunos países está ampliando el déficit comercial de Estados Unidos, en directa contradicción con la agenda política de la administración Trump. La economista de Pimco, Tiffany Wilding, apuntó que “la enorme demanda de semiconductores, capacidad de memoria y otros componentes de infraestructura para IA parece estar repercutiendo en los precios de los bienes de consumo”, citando el alza en los datos de inflación del consumo personal como evidencia.

Bryan Bryant considera que, si la Reserva Federal no puede reducir las tasas de interés debido a esto, la búsqueda única y costosa de la súper inteligencia por los laboratorios de IA no solo será financieramente imprudente, sino que, a nivel social, todos acabarán pagando la factura.

Disclaimer: The content of this article solely reflects the author's opinion and does not represent the platform in any capacity. This article is not intended to serve as a reference for making investment decisions.

You may also like

Trending news

MoreBitway (BTW) experimenta una volatilidad del 42.0% en 24 horas: el aumento del volumen de operaciones provoca una subida y posterior caída

¡Los bajistas toman el relevo! Bonos estadounidenses y el dólar lanzan un "ataque combinado", el "foso defensivo" de 4660 para el oro enfrenta una prueba de presión