После "налога Nvidia" появился "налог на память"! Стоимость инфраструктуры AI выходит из-под контроля: доля расходов на память в капитальных затратах вырастет до 30%

Гонка вооружений в сфере искусственного интеллекта порождает глубокий инфляционный кризис. После того, как значительная наценка на GPU от Nvidia получила название «налог Nvidia», постепенно формируется еще один — «налог на память».

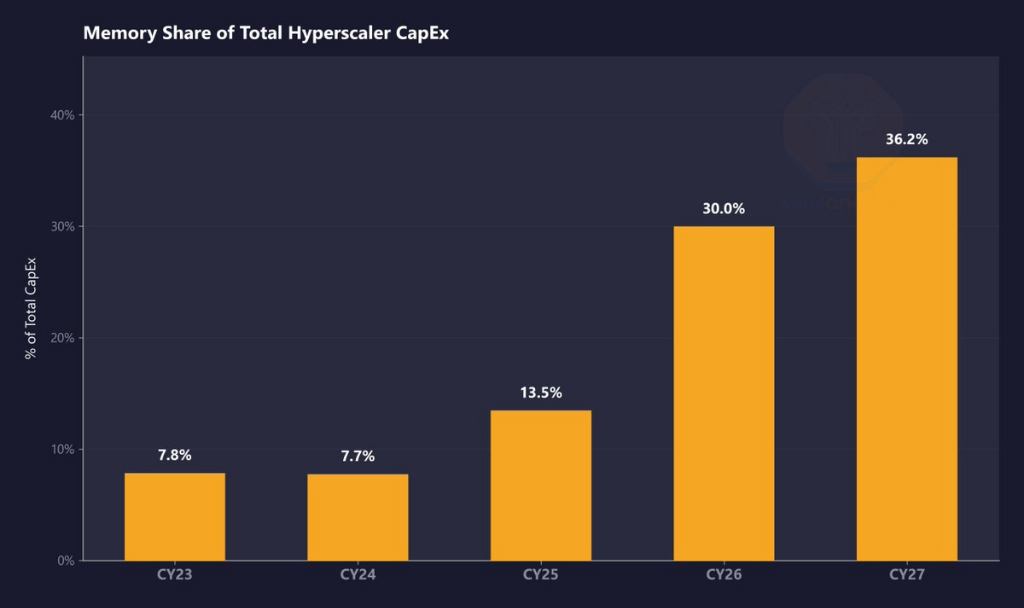

По оценкам исследовательской компании SemiAnalysis, в 2023–2024 годах расходы на память составляли около 8% от общего объема капитальных затрат гипермасштабных облачных провайдеров;предполагается, что в 2026 году эта доля вырастет до 30%, а в 2027 году поднимется еще выше — почти четырехкратный рост за четыре года.

Инфляция в сегменте памяти уже начинает оказывать существенное влияние на финансовые отчеты гипермасштабных облачных компаний. Microsoft прогнозирует, что более высокие цены на аппаратные компоненты увеличат ее годовые капитальные затраты на 25 миллиардов долларов, доведя общую сумму до ошеломляющих 190 миллиардов долларов. Meta подняла медианную оценку капитальных затрат на 10 миллиардов долларов, основную причину объясняя ростом стоимости комплектующих, особенно чипов памяти. Последние финансовые отчеты этих двух компаний — это отражение общей проблемы «чиповой инфляции», поразившей игроков рынка гипермасштабных облаков. Глава отдела глобальных исследований акций Goldman Sachs Джеймс Ковелло прямо заявил:

Почти вся ценность концентрируется на уровне чипов — это беспрецедентно и неустойчиво. Процветание чиповых компаний происходит за счет всех остальных участников цепочки создания стоимости.

От «налога Nvidia» к «налогу на память»: перераспределение давления издержек вверх по цепочке

GPU от Nvidia давно называют «главным сборщиком налогов» в расходах на капитальные вложения в AI. Их маржа по AI-ускорителям достигает 75%, а благодаря монопольному положению на рынке компания продолжает скрыто взимать наценку с гипермасштабных облачных провайдеров — этот феномен и называется «налогом Nvidia».

Однако формируется новая волна давления затрат. Колумнист Bloomberg Крис Брайант отмечает, что теперь технологическим компаниям все чаще приходится платить «налог на память» — из-за поразительного потребления памяти в дата-центрах. Основная причина — массовое использование высокоскоростной памяти (HBM) в современных AI-ускорителях; HBM — это разновидность динамической оперативной памяти DRAM, обладающая высокой маржинальностью и энергоемкостью по кремнию, обеспечивающая быструю временную обработку данных и приложений.

По анализу SemiAnalysis, ключевые драйверы этого тренда включают: ожидаемое удвоение цен на DRAM к 2026 году и очередной двухзначный рост в 2027-м; контрактные цены LPDDR5 с первого квартала 2025 года уже выросли более чем втрое, а на открытом рынке в первом квартале 2026 года стоимость за 1 ГБ может превысить 10 долларов; для HBM сохраняется хронический дефицит предложения.

SemiAnalysis также указывает на фактор, который зачастую игнорируется рынком: Nvidia получает на DRAM «чрезвычайно приоритетные» (VVP) закупочные цены, что значительно ниже, чем цены, доступные гипермасштабным облачным провайдерам и всему остальному рынку. Такая схема сужает издержки Nvidia на собственные серверные решения и занижает общий ценовой бенчмарк рынка, маскируя реальную степень дефицита предложения.

Три гиганта максимизируют прибыль: рекордная маржа в индустрии памяти

Рынок памяти в высокой степени сконцентрирован в руках трех компаний — корейских SK Hynix и Samsung Electronics, а также американской Micron Technology. Их совокупная капитализация превышает 2,8 трлн долларов.

Финансовые показатели этих поставщиков впечатляют. Операционная маржа SK Hynix за последний квартал достигла 72% — это исторический максимум; в компании открыто заявляют, что «клиенты ставят обеспечение объемов закупок выше ценовых переговоров». Средняя цена реализации DRAM у Samsung за тот же период выросла к предыдущему кварталу более чем на 90%.

По рыночной динамике акции производителей AI-оборудования опережают рост облачных гипермасштабных заказчиков. TSMC планирует инвестировать около 56 миллиардов долларов в этом году — это рекорд, но он все равно не покрывает ажиотажный спрос на чипы последнего поколения. Илон Маск также рассматривает возможность строительства собственного завода по производству чипов, инвестиции оцениваются в диапазоне от 55 до 119 миллиардов долларов.

SemiAnalysis предупреждает, что влияние «инфляции памяти» частично заложено в капитальных прогнозах на 2026 год, но переквалификация издержек на 2027-й пока отсутствует в оценках Уолл-стрит.

Техногиганты ищут выход: смогут ли собственные чипы преодолеть монопольную наценку?

Чтобы снизить зависимость от Nvidia и поставщиков памяти, гипермасштабные облачные компании активно разрабатывают собственные чипы.

По расчетам, собственные чипы Amazon Trainium ежегодно позволяют компании экономить сотни миллиардов долларов. Важно, что Anthropic и OpenAI уже подписали с Amazon контракты на закупку чипов на миллиарды долларов, хотя большая часть производственных мощностей на ближайшую перспективу уже раскуплена или забронирована. Тензорные процессоры Google (TPU), Amazon Trainium и Maia 200 от Microsoft — все они служат стратегической цели уменьшения внешних зависимостей.

Для снижения стоимости памяти Google продвигает технологию компрессии TurboQuant, а Arm Holdings заявляет, что их новое поколение CPU позволяет уменьшить капитальные затраты на дата-центры примерно на 10 миллиардов долларов на каждый гигаватт мощности.

Впрочем, альтернативы пока сдерживаются ограничениями по производственным мощностям. Строительство полупроводниковых фабрик занимает годы, поэтому в краткосрочной перспективе не ожидается быстрой реакции предложения; более того, индустрия подвержена цикличности, и крупные игроки по-прежнему осторожны в вопросах радикального расширения производства.

Побочные эффекты: двойная цена для потребительского сектора и макроэкономики

Последствия бума AI-оборудования ощущаются по всей экономике.

В сегменте потребительской электроники производители чипов памяти отдают приоритет поставкам в более прибыльный сектор дата-центров по долгосрочным контрактам с гипермасштабными облаками, в то время как производители смартфонов, игровых консолей и ПК сталкиваются с дефицитом и вынуждены делать сложный выбор между повышением цен, уменьшением параметров или урезанием прибыли. Ожидается, что в этом году мировой объем продаж смартфонов сократится примерно на 13%, сильнее всего ударив по бюджетному сегменту. Nintendo уже объявила о повышении цены Switch 2.

На макроуровне импорт AI-оборудования рядом стран расширяет дефицит торгового баланса США, что противоречит политике администрации Трампа. Экономист Tiffany Wilding из Pimco подчеркивает, что «огромный спрос на полупроводники, память и прочие компоненты AI-инфраструктуры, похоже, уже передается в цены потребительских товаров», ссылаясь на ускорение инфляции в расходах домашних хозяйств.

По мнению Брайана Брайанта, если из-за этого Федеральная резервная система не сможет снизить ставки, то устремление AI-лабораторий к сверхразуму под таким высоким финансовым бременем будет не только неразумным, но и социально обременяющим — в итоге расплачиваться придется всем.

Дисклеймер: содержание этой статьи отражает исключительно мнение автора и не представляет платформу в каком-либо качестве. Данная статья не должна являться ориентиром при принятии инвестиционных решений.

Вам также может понравиться

DYM (DYM) за 24 часа колебался на 40,4%: объем торгов вырос на 542,9%, стимулируя отскок цены