1つのチップが1つのトレイに匹敵、史上最大のAIチップIPOが実現!5人のベテランチップエンジニアが10年をかけてAIコンピューティングパワーの爆発的成長に賭ける

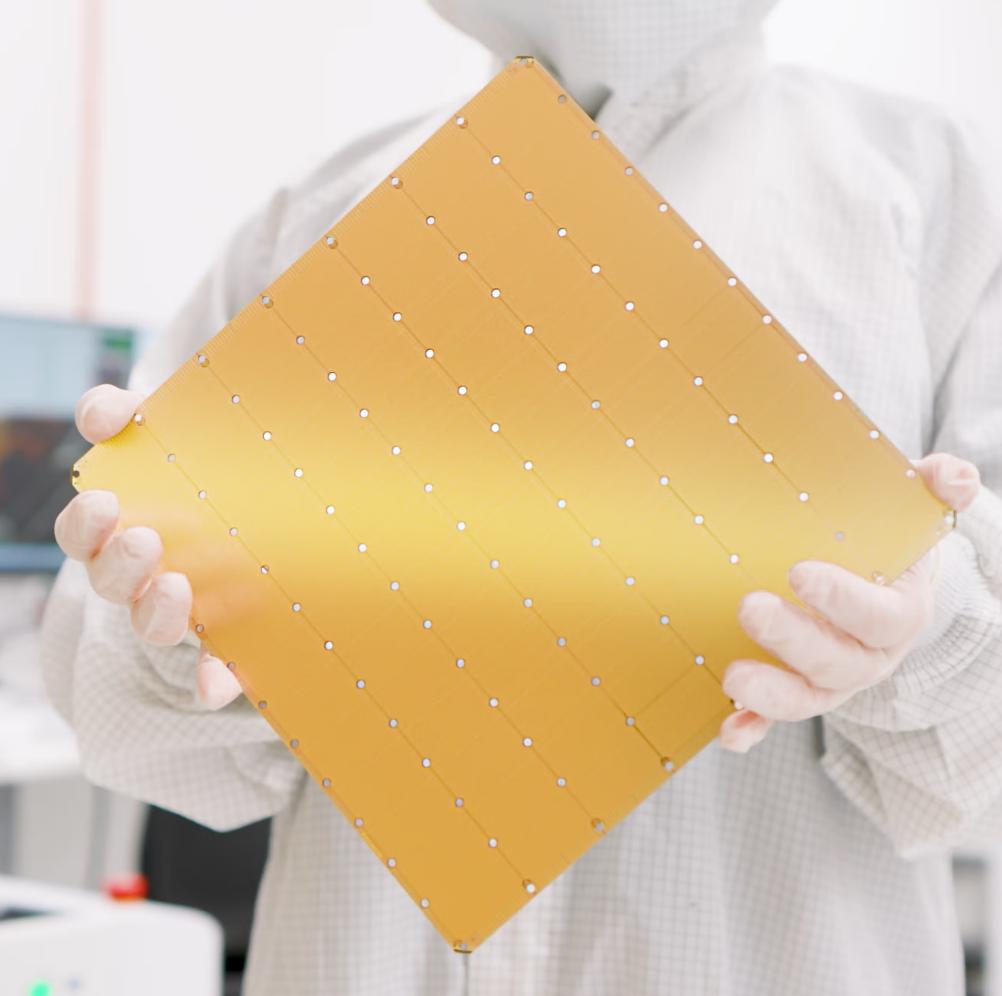

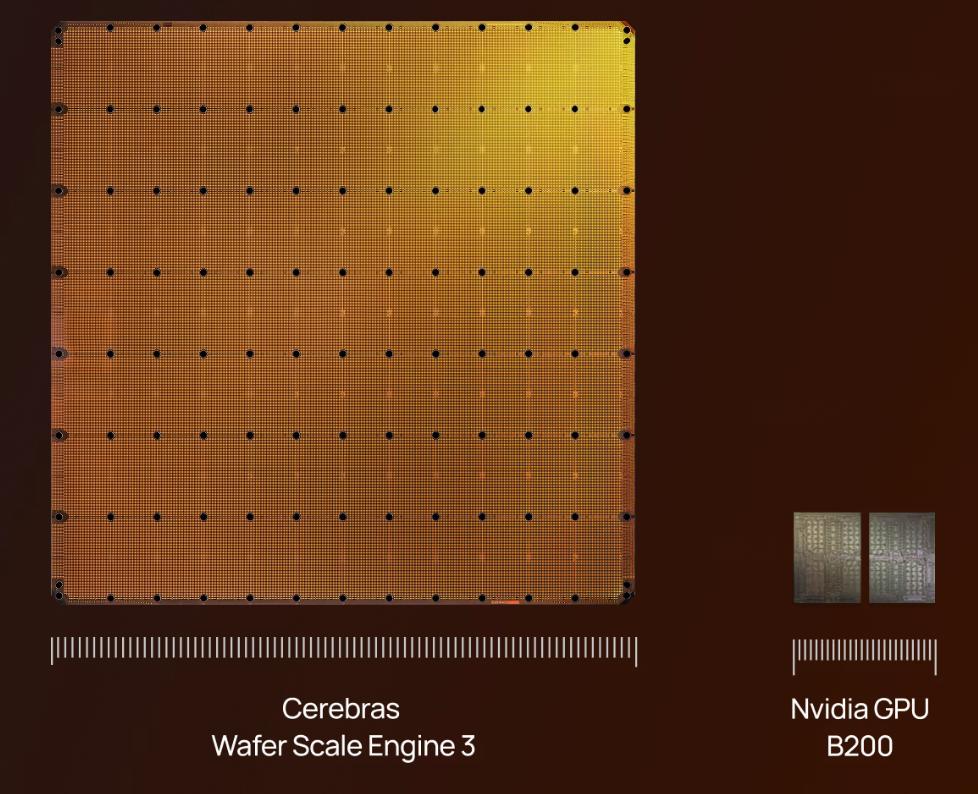

一般的なパソコン用チップは爪の大きさ程度で、GPU も手のひらサイズが普通ですが、米カリフォルニア州のCerebrasという会社が製造したチップは大型のディナープレートほどもあり、直径は200ミリを超え、面積は46,225平方ミリメートル、そして4兆個のトランジスタが集積されています。

この企業は2026年5月14日にNASDAQに上場し、発行価格185ドル、初値350ドル、初日に89%急騰し、時価総額は750億ドルに達しました。5人の共同創業者のうち4人はAMDに買収されたサーバー企業SeaMicro出身、もう1人はMIT出身です。2015年から約10年にわたりひっそりと事業を進め、今やウェハレベルのチップでAI計算力競争の最前線に立っています。

(出典:cerebras.ai)

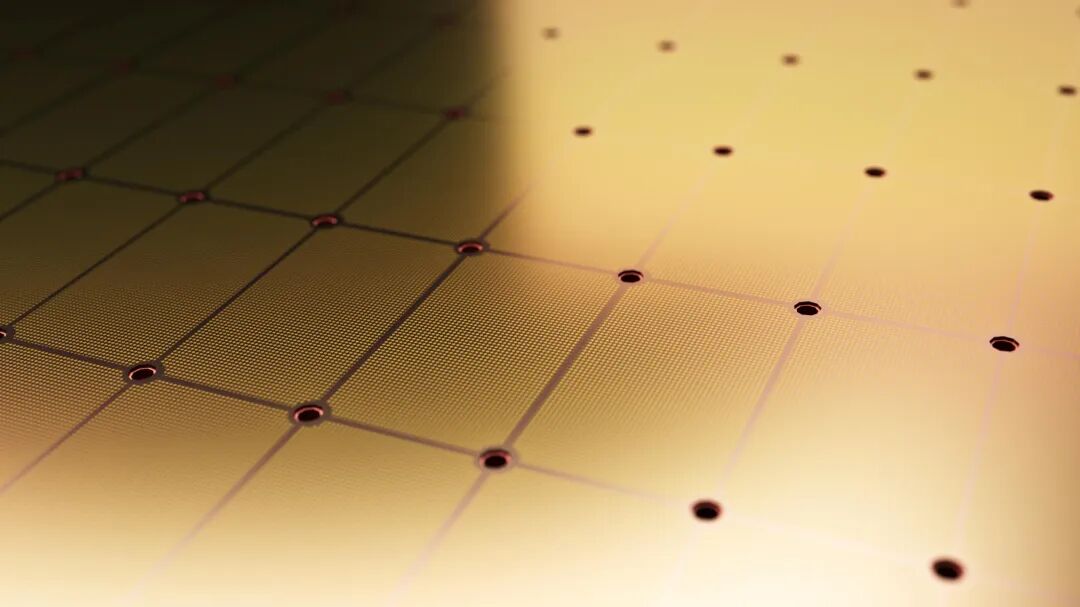

Cerebrasのコア製品はウェハスケールエンジンと呼ばれ、現在は第3世代WSE-3となっています。従来のチップ製造は一枚のウェハを小さなチップに何百個も切り出してきましたが、Cerebrasはこの常識を覆し、切断せずに1枚のウェハをそのまま1つのチップとして仕上げています。このウェハ上には84個の仮想ダイが集積され、それぞれのダイに約10,700のコアが含まれ、全体で90万の計算コアとなっています。

これらのコアは2Dメッシュ型のオンチップ・ネットワークで接続され、各コアは5ポートのルーターを装備し、4方向へのデータ通信およびローカルの読み書き操作をサポートします。チップ全体のメモリ帯域は秒間21エクサバイト、オンチップネットワーク帯域は秒間214エクサバイトに達します。

(出典:cerebras.ai)

WSE-3チップはTSMCの5nmプロセスで製造され、各計算コアの面積は約3.8万平方マイクロメートル。その半分は48KBのローカルSRAMで、もう半分はロジック回路です。チップ全体でSRAMは44GBとなります。すべてのメモリはコアのすぐ隣に配置され、データと計算ユニットの物理的な距離は数十ミクロンしかなく、従来のGPUのように外部の高帯域メモリHBM経由でデータを取得する必要がありません。Cerebrasは、同等のシリコン面積でのメモリ帯域幅がGPUの約200倍であると主張しています。

(出典:cerebras.ai)

このアーキテクチャは特にニューラルネットワークの非構造化スパース処理に適しており、従来のGPUは重みが0かどうかに関係なく計算を行いますが、Cerebrasでは送信側で0値を除去し、非0のデータのみをオンチップネットワークで対応する計算コアに送ります。各データパケットは16ビットデータと16ビット制御情報を含み、受信側はデータを受信すると自動的に乗加演算を実行します。この方式により無駄な計算を大幅に省き、スパース度の高いモデルで顕著な加速効果が得られます。

同社の技術ホワイトペーパーによると、一般的な行列積よりランクが低いBLAS演算(行列×ベクトルやベクトル×スカラー)では、従来チップはメモリ帯域の制約でフル稼働できませんが、Cerebrasアーキテクチャは十分なメモリ帯域で高い利用率を維持できます。

(出典:cerebras.ai)

Cerebrasのもう1つのコア技術がWeight Streamingです。大規模モデルを訓練するとき、モデルの重みはチップ上には保存せず、MemoryXと呼ばれる外部デバイスにストリーミング転送でWSE-3チップへ届けます。各ネットワーク層の計算時、重み情報は外部DRAMやフラッシュから読み込まれ、チップの入出力インターフェースを通じて計算コアに供給されます。

重みがコアに届くと、ローカルのアクティベーション値とのバッチ乗加演算を行い、計算後は重みを破棄し、チップ上に保持しません。この方式により、モデルサイズはチップのメモリ容量に制限されず、1兆パラメータ級の超巨大モデルのサポートが可能となります。

(出典:cerebras.ai)

ソフトウェア面では、Cerebrasは完全なコンパイラツールチェーンを提供しており、PyTorchやTensorFlowで記述されたモデルを自動的に90万コアへマッピングできます。Transformerモデルの場合、アクティベーションテンソルは3次元(バッチサイズ・シーケンス長・隠れ次元)です。コンパイラは隠れ次元をX方向、バッチサイズとシーケンス長をY方向に分割して割り当てます。

行列積計算時は、重みを行方向に全コアへブロードキャストして乗加演算をトリガーし、その後列方向で部分和を集約し、最終結果をチップ上で次の層へ渡します。計算スケジューリングはすべて静的に設定され、命令は実行前に一括ロードし、実行中に変更されません。

(出典:cerebras.ai)

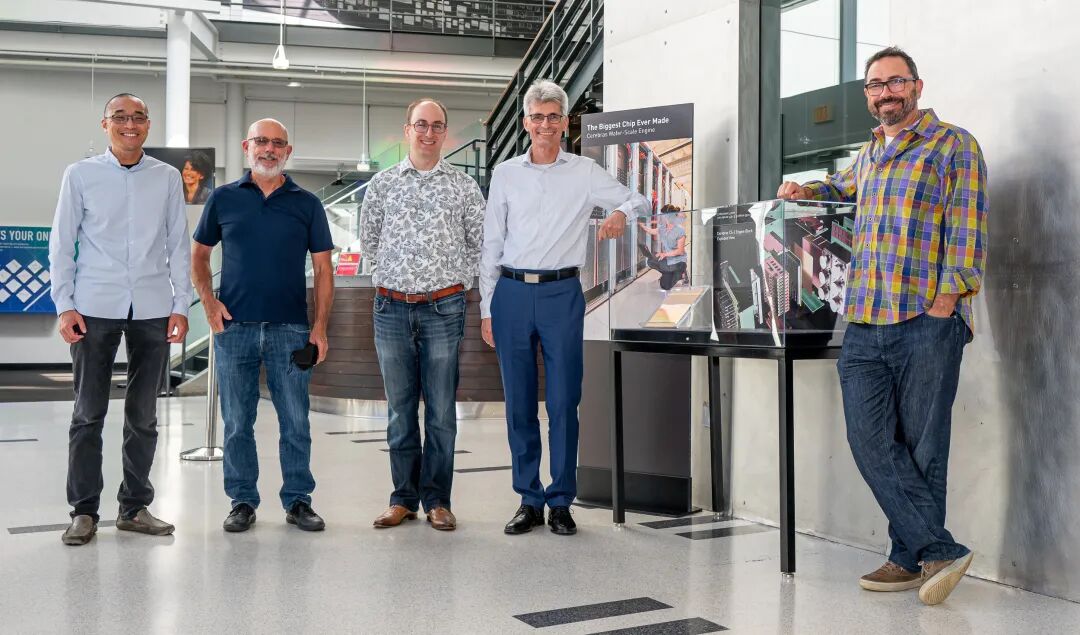

Cerebrasの5人の共同創業者はいずれもチップとシステムに関する深いバックグラウンドを持っています。

CEOのAndrew Feldmanはスタンフォード大学出身で、以前設立したマイクロサーバ会社SeaMicroはAMDに3億5700万ドルで買収されています。

CTOのSean LieはMIT電気工学・コンピュータサイエンス学士と修士を持ち、SeaMicroではIO仮想化アーキテクトとして活躍し、AMD買収後はAMDフェローとなりました。

システムアーキテクトのJean-Philippe Frickerはローザンヌ連邦工科大学修士で、DSSD、SeaMicro、アルカテル-ルーセント、Riverstone Networksでハードウェア設計の職務に就いていました。

先進技術チーフアーキテクトのMichael JamesはUCバークレーで分子神経生物学・数学・コンピュータサイエンスの学位を持ち、SeaMicroでは分散システムソフトウェアを担当しました。

名誉引退済みの元CTO Gary Lauterbachは50件を超える特許を有し、Sun Microsystemsの著名なエンジニアでUltraSPARC III/IVマイクロプロセッサのアーキテクトを主導しました。

Cerebrasのビジネスモデルは主にCS-3システムという完成品販売です。CS-3はWSE-3チップを中心に設計されたフルシステムで、データセンターの標準ラックに設置できます。顧客は主に研究機関や企業で、例としてUAEのAI企業G42、ムハンマド・ビン・ザイードAI大学(MBZUAI)が挙げられます。上場資料によると、2025年Cerebrasの売上は5億1千万ドル、内G42が24%、MBZUAIが62%を占めました。通年純利益は2億3800万ドルで、前年の4億8200万ドル赤字から黒字転換しました。

Cerebrasは2024年にも上場申請を試みましたが、その時は売上が主に顧客G42に依存し、収入の87%を占めていました。UAE関連取引は米国外国投資委員会(CFIUS)の審査が必要となり、最終的に承認は得たものの、一度上場申請を取り下げました。今回の再上場では顧客集中度は改善し、最大顧客MBZUAIの比率は62%となりましたが、上位2社合計で86%に上り、集中リスクは依然残っています。

Cerebrasの技術路線はAIチップ分野で独自の存在です。ほかの挑戦者の多くはGPUに倣った構成(小規模のコアとHBM)を採用していますが、Cerebrasは巨大な1枚ウェハで課題解決に挑戦しています。このやり方はスパース計算や大規模モデル推論で明らかな強みがある一方で、製造コストや歩留まりの課題も抱えます。

ウェハ全体で致命的な欠陥が1つでもあればチップ全体に影響が及ぶため、Cerebrasは設計上で冗長リンクおよび自動エラー修正機構を導入してこの課題に取り組んでいます。ウェハスケールチップの消費電力や放熱もエンジニアリングの難題であり、CS-3システムは専用の液体冷却ソリューションを備えています。

OpenAI、Anthropic、SpaceXなどのAI企業が相次いで上場を控えるなか、AIチップ業界は資本市場の注目の的になっています。CerebrasはNASDAQ上場第一号の純AIチップ新興株として初日89%上昇し、後続企業への明るいシグナルとなりました。

ただしAIチップ市場の競争も激化しており、NVIDIAに加え、AMDやIntel、複数のスタートアップも新製品を続々と出しています。Cerebrasのウェハスケール方式が主流AIトレーニング市場で地位を確立できるかどうかは、今後より多くの顧客と長期間の実証が必要です。

免責事項:本記事の内容はあくまでも筆者の意見を反映したものであり、いかなる立場においても当プラットフォームを代表するものではありません。また、本記事は投資判断の参考となることを目的としたものではありません。

こちらもいかがですか?

IAG(Iagon)24時間で44.2%の変動:取引量の急増で急騰後に急速な反落

理事Barrが指導部と対立:FRBはバランスシート縮小をすべきでなく、そのために銀行システムのレジリエンスを低下させるべきでもない

米ドル高が貴金属強気派のムードを抑制、ニューヨークの金価格が14日に約1%下落、銀価格は4%超の下落

Applied Materials (AMAT) 2026年度第2四半期決算ハイライト:AI需要の強さが牽引、粗利益率は過去25年で最高、Q3ガイダンスを大幅上方修正