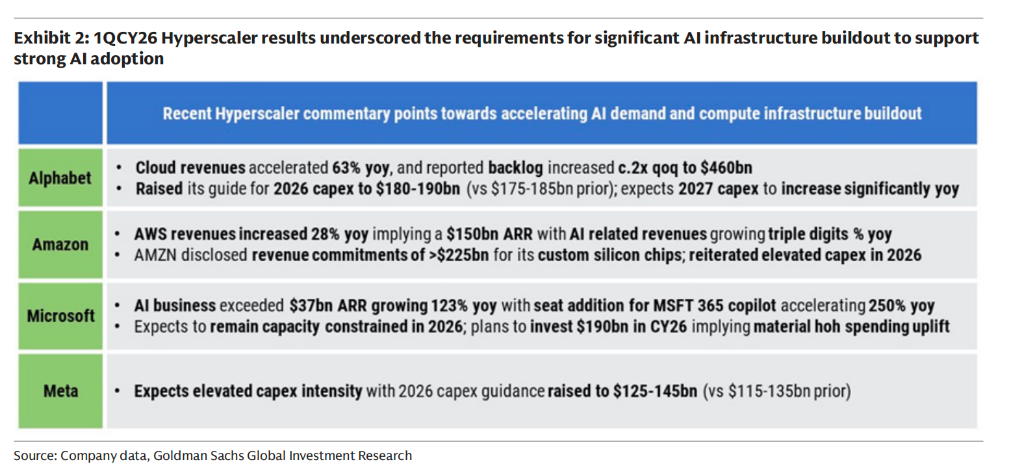

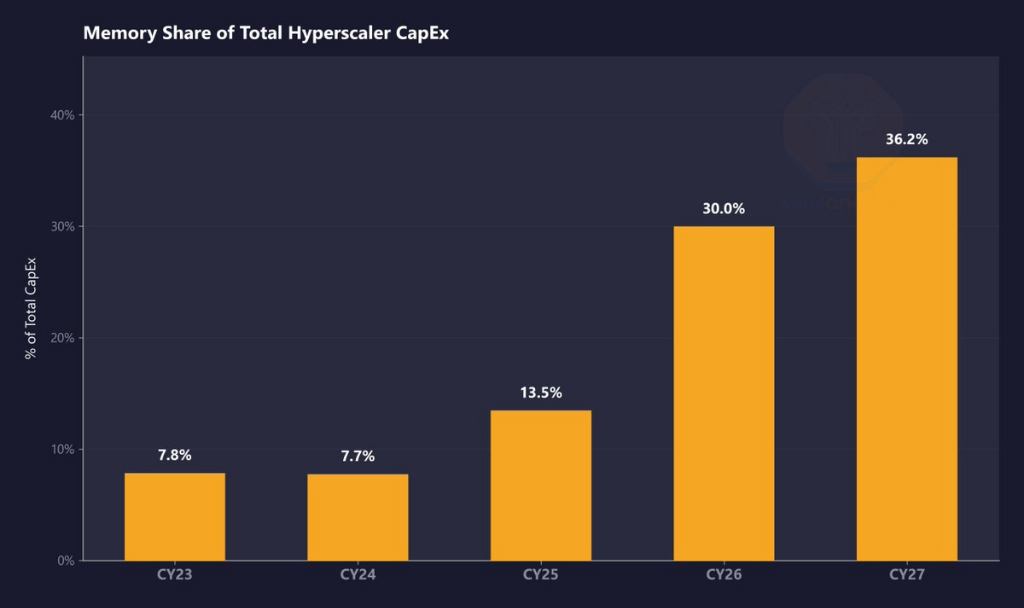

Após o "imposto Nvidia", agora vem o "imposto da memória"! O custo da infraestrutura de IA está fora de controle: a participação da memória nos investimentos de capital deve disparar para 30%.

A corrida armamentista da IA está gerando uma crise inflacionária profunda. Após o chamado “imposto Nvidia” — o alto ágio das GPUs Nvidia —, um novo “imposto da memória” está surgindo silenciosamente.

Segundo estimativas da empresa de pesquisa de mercado SemiAnalysis, entre 2023 e 2024, os gastos com memória representaram cerca de 8% do total de despesas de capital das empresas de computação em nuvem de hiperescala; estima-se que essa proporção saltará para 30% em 2026, e aumentará ainda mais em 2027 — uma mudança quase quatro vezes maior em quatro anos.

Essa inflação da memória já está afetando de forma significativa os balanços das grandes provedoras de serviços de nuvem. A Microsoft prevê que os preços mais altos dos componentes de hardware aumentarão seus investimentos em capital em US$ 25 bilhões ao ano, chegando à impressionante quantia de US$ 190 bilhões. O Meta aumentou a previsão mediana de investimento em US$ 10 bilhões, atribuindo principalmente aos custos de componentes, especialmente dos chips de memória. Os balanços financeiros mais recentes dessas duas empresas refletem o dilema inflacionário dos chips enfrentado pela indústria de computação em nuvem de hiperescala. James Covello, chefe global de pesquisa de ações do Goldman Sachs, diz abertamente:

Praticamente todo o valor está se acumulando na camada dos chips, o que é sem precedentes e insustentável. A prosperidade das empresas de chips está ocorrendo à custa de todas as demais empresas da cadeia de valor.

Do “imposto Nvidia” ao “imposto da memória”: a pressão de custo é repassada

As GPUs da Nvidia são conhecidas há tempos no setor como o “maior cobrador de impostos” sobre os gastos de capital em IA. Com margens brutas de até 75% em seus aceleradores de IA, a Nvidia, monopolizando o mercado de aceleradores de IA, vem cobrando consistentemente um ágio implícito das provedoras de computação em nuvem de hiperescala — fenômeno conhecido como “imposto Nvidia”.

No entanto, uma nova pressão de custo está se formando. Chris Bryant, colunista da Bloomberg, observa que as empresas de tecnologia estão cada vez mais obrigadas a pagar um “imposto da memória” — devido ao consumo descomunal de memória nos centros de dados. A principal razão é que os aceleradores de IA mais avançados exigem grandes quantidades de memória de alta largura de banda (HBM), que é uma memória DRAM dinâmica densa e lucrativa, consumidora intensiva de silício, e fornece armazenamento temporário ultrarrápido para dados e aplicações.

De acordo com análise da SemiAnalysis, os principais fatores desse movimento incluem: o preço do DRAM deve mais que dobrar até 2026, com novo aumento percentual de dois dígitos previsto para 2027; o preço contratual do LPDDR5 já triplicou desde o primeiro trimestre de 2025, e o preço de mercado aberto pode superar US$ 10 por GB no primeiro trimestre de 2026; o HBM permanece estruturalmente restrito por falta de oferta.

A SemiAnalysis ainda destaca uma dinâmica pouco observada pelo mercado: a Nvidia desfruta de preços de aquisição de DRAM “altamente prioritários” (VVP), muito inferiores aos pagos pelas provedoras de nuvem de hiperescala e pelo mercado em geral. Esse arranjo reduz a exposição de custos da Nvidia em servidores, pressionando o preço de referência do mercado e encobrindo o real grau de escassez na oferta.

Três gigantes colhem lucros históricos: o setor de memória atinge recordes de rentabilidade

O poder de decisão do mercado de memória está altamente concentrado nas mãos de três empresas — SK Hynix e Samsung Electronics, da Coreia do Sul, e a americana Micron Technology. O valor de mercado combinado das três já ultrapassa US$ 2,8 trilhões.

Os números financeiros desses fornecedores impressionam. A SK Hynix registrou margem operacional de 72% no último trimestre, um recorde; a empresa admite que os clientes estão “priorizando garantir volume de compra em vez da negociação de preço”. No mesmo período, o preço médio dos DRAMs da Samsung subiu mais de 90% em relação ao trimestre anterior.

Do ponto de vista de mercado, as ações das fornecedoras de hardware para IA normalmente superam as das compradoras de computação em nuvem de hiperescala. A TSMC planeja investir US$ 56 bilhões este ano, valor recorde, mas ainda insuficiente para atender à alta demanda por produtos avançados. Elon Musk estaria considerando construir uma fábrica própria de chips, com investimento entre US$ 55 bilhões e US$ 119 bilhões.

A SemiAnalysis alerta que o impacto do aumento dos custos com memória já está parcialmente refletido nas previsões de capex para 2026, mas o reajuste previsto para 2027 ainda não aparece nas projeções atuais de Wall Street.

Tentativa de resposta das gigantes: projetos próprios podem romper o ágio monopolista?

Diante do elevado custo de aquisição, as provedoras de nuvem de hiperescala buscam desenvolver seus próprios chips, buscando escapar da dependência de Nvidia e dos fornecedores de memória.

O chip Trainium próprio da Amazon pode economizar centenas de bilhões de dólares por ano em gastos. Vale notar que Anthropic e OpenAI assinaram contratos bilionários de compra de chips com a Amazon, ainda que a maior parte da produção já esteja vendida ou reservada no curto prazo. O Tensor Processor Unit (TPU) do Google, o Trainium da Amazon e o Maia 200 da Microsoft representam iniciativas dessas empresas para reduzir a dependência externa.

No quesito redução de custos de memória, a tecnologia de compressão TurboQuant do Google pode ser promissora, enquanto a Arm Holdings afirma que sua nova geração de CPUs pode reduzir o custo de construção de data centers em cerca de US$ 10 bilhões por gigawatt.

No entanto, as opções alternativas ainda enfrentam gargalos de capacidade. Fábricas de semicondutores levam anos para serem construídas e não oferecem respostas de oferta de curto prazo; além disso, o setor é fortemente cíclico e muitas empresas ainda relutam em ampliar a produção rapidamente.

Efeito cascata: custos duplos no mercado de consumo e na economia global

O boom do hardware de IA está impondo custos à economia como um todo de várias formas.

No mercado de consumo, os fabricantes de chips de memória priorizam os pedidos de longo prazo e mais lucrativos de data centers e nuvem de hiperescala; por outro lado, fabricantes de smartphones, videogames e PCs enfrentam escassez — restando-lhes apenas a opção entre repassar o aumento de custo, reduzir componentes ou sacrificar margem de lucro. Prevê-se queda de cerca de 13% nas vendas globais de smartphones este ano, com maior impacto nos modelos de entrada. A Nintendo já anunciou aumento no preço do Switch 2.

No contexto macroeconômico, alguns países estão elevando o déficit comercial dos EUA ao importar hardware relacionado à IA, entrando em rota de colisão com a política da administração Trump. Tiffany Wilding, economista da Pimco, aponta que “a enorme demanda por semicondutores, produção de memória e outros componentes de infraestrutura para IA está sendo repassada para os preços dos bens de consumo”, citando a inflação do consumo pessoal como evidência.

Bryan Bryant acredita que, caso o Federal Reserve não consiga cortar as taxas de juros devido a esse movimento, o investimento das labs de IA em superinteligência será não apenas financeiramente imprudente — mas, do ponto de vista social, o preço final será pago por todos.

Disclaimer: The content of this article solely reflects the author's opinion and does not represent the platform in any capacity. This article is not intended to serve as a reference for making investment decisions.

You may also like

SD (Stader) oscila 69,7% em 24 horas: volume de negociação dispara mais de 4000% sem catalisador claro

Goldman Sachs: ASML está gravemente subestimada!